vir: https://machinelearningmastery.com/top-7-small-language-models-you-can-run-on-a-laptop/

-

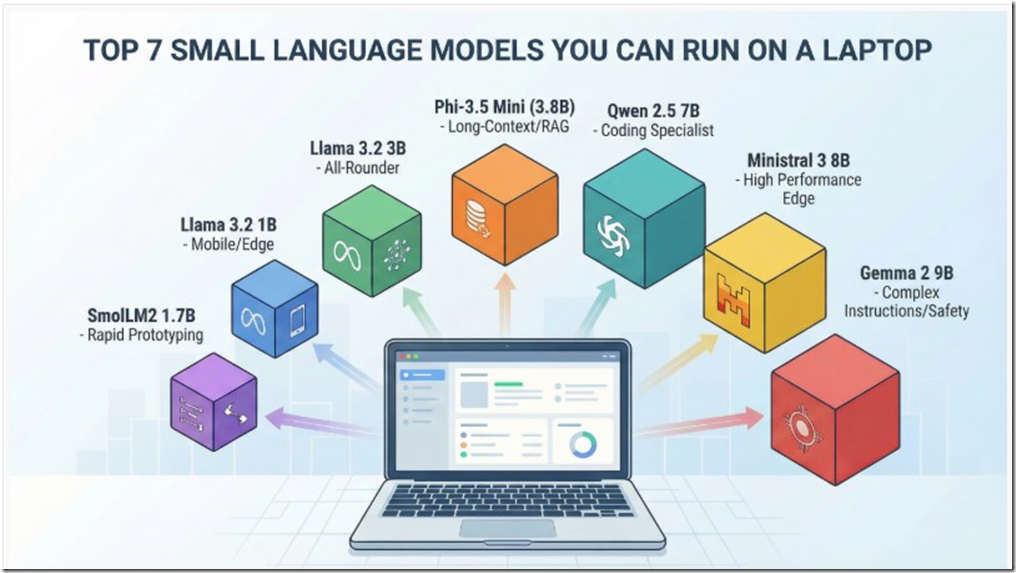

Članek predstavi 7 majhnih jezikovnih modelov (SLM), ki realno tečejo na običajnih prenosnikih, z jasnim fokusom na praktične use-case scenarije, ne benchmarke.

-

Ključni parametri pri izbiri so: kontekstno okno, namen (chat, koda, RAG, prototipiranje) in RAM zahteve (4-bit vs 16-bit).

-

Phi‑3.5 Mini izstopa za dolg kontekst in RAG, Llama 3.2 3B kot univerzalni “default”, Qwen 2.5 7B pa kot specialist za kodo in matematiko.

-

Ministral 3 8B in Gemma 2 9B sta “upper bound” za kakovost na prenosniku, SmolLM2 1.7B in Llama 3.2 1B pa ciljata na mobilne/edge/development scenarije.

-

Avtor poudari tudi licenčne omejitve (gated modeli kot Llama/Gemma), potrebo po preverjanju model cardov in praktične namige za lokalni zagon prek Ollama/llama.cpp.

DEJSTVA

-

Članek opisuje 7 SLM modelov: Phi‑3.5 Mini, Llama 3.2 3B, Llama 3.2 1B, Ministral 3 8B, Qwen 2.5 7B, Gemma 2 9B in SmolLM2 1.7B, vse z možnostjo lokalnega pogona.

-

Phi‑3.5 Mini (3.8B) cilja na dolg kontekst (RAG, dolgi dokumenti) in pri 4-bit kvantizaciji potrebuje približno 6–10 GB RAM.

-

Llama 3.2 1B lahko v 4-bit kvantizaciji teče v 2–4 GB RAM, kar jo omogoča na telefonih in drugih edge napravah.

-

Qwen 2.5 7B je pozicioniran kot najboljši za kodo in matematično sklepanje v svojem razredu (7B), z močno usmerjenim treningom na tehnične vsebine.

-

Gemma 2 9B in Ministral 3 8B zahtevata tipično 10–12 GB RAM v 4-bit kvantizaciji in ciljata na kompleksnejše naloge ter produkcijske scenarije na zmogljivejših prenosnikih.

Struktura članka in glavno sporočilo

Članek je vodič za razvijalce, ki želijo lokalno poganjati LLM na prenosniku brez odvisnosti od cloud API-jev. Modelle razvršča po primernosti za tipične naloge (RAG, chat, koda, prototipiranje), ne po “leaderboard” rezultatih. Poudarek je na praktičnih vprašanjih: koliko RAM-a potrebujem, za kaj je model najbolj smiseln in kje dobim uteži (Hugging Face, Ollama).

Za vsakega modela podaja: kratek opis, “best for”, tipične RAM zahteve (4-bit/16-bit) in konkretne ukaze/viri za prenos (npr. ollama pull ..., povezave na HF). Zaključek bralca vodi skozi odločitveno logiko: dolg kontekst → Phi‑3.5, generalni chat → Llama 3.2 3B, koda → Qwen 2.5 itd.

Kratek povzetek modelov

-

Phi‑3.5 Mini (3.8B): dolg kontekst, RAG, tehnična dokumentacija, potrebuje ~6–10 GB RAM (4-bit), idealen za dokumentno intenzivne use-case.

-

Llama 3.2 3B: univerzalni “workhorse” za chat, Q&A, klasifikacijo, povzemanje in customer support; 4-bit potrebuje ~6 GB RAM.

-

Llama 3.2 1B: skrajno učinkovit, za mobilne/IoT/edge scenarije in enostavnejše klasifikacije ali domensko omejen Q&A, 4-bit v 2–4 GB RAM.

-

Ministral 3 8B: optimiziran edge model z zmogljivostjo blizu 13B razreda; namenjen kompleksnejšemu sklepanju, večkrožnim pogovorom in generiranju kode; 4-bit ~10 GB RAM.

-

Qwen 2.5 7B: specialist za kodo in matematično sklepanje, močan pri tehnični dokumentaciji in večjezičnih nalogah (zlasti kitajščina/angleščina); 4-bit ~8 GB RAM.

-

Gemma 2 9B: fokus na varnostnem filtriranju in natančnem sledenju navodilom; primeren za naloge z višjimi varnostnimi zahtevami in kompleksnimi navodili; 4-bit ~12 GB RAM.

-

SmolLM2 1.7B: zelo majhen model za prototipiranje, učenje in enostavne NLP naloge (sentiment, kategorizacija); 4-bit ~4 GB RAM.

Izbor modela in licenčni vidiki

Avtor jasno pove, da se je treba odločati po lastnem use-caseu in omejitvah: dolg kontekst, mobilnost, kvaliteta, koda, hitrost prototipiranja. Nekatere družine (Llama, Gemma) so “gated” in zahtevajo sprejem licence ter včasih avtentikacijo za prenos uteži. Priporočilo je, da se zadnje stanje konfiguracije (kontekst, kvantizacija, licenca) vedno preveri v uradnem model cardu oziroma na strani v Ollama katalogu, ker se revizije in default nastavitve pogosto spreminjajo.

Praktično: vse modele je možno poganjati lokalno, tipično prek runtimov kot llama.cpp ali prek Ollama, ki poenostavi pull in lokalni inference. Članek zaključi z motivacijo, da je vstopna ovira za lokalni AI najnižja doslej – vzemi model, ga preizkusi na svojem konkretnem primeru in iteriraj.

Opazke iz komentarjev

V komentarjih bralci omenjajo dodatne modele (npr. LFM 1.2B) in novejše konfiguracije, vključno z Gemma3 1B na Pixel telefonu prek Termux + Ollama ter uspešnim zagonom 4B modelov na 8 GB RAM prenosnikih. Avtor v odgovorih priznava, da se področje zelo hitro razvija in da bodo potrebne posodobitve članka za vključitev novih modelov in realnih konfiguracij iz prakse.