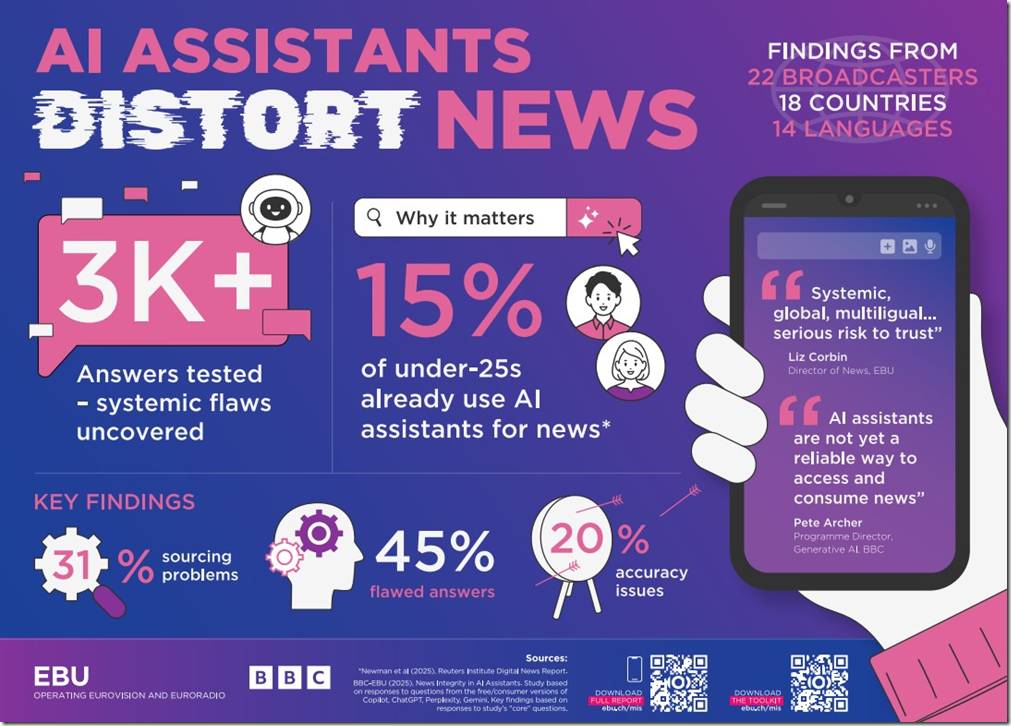

Gre za eno največjih mednarodnih analiz ravnanja AI asistentov z novicami, ki vključuje 22 javnih medijskih organizacij iz 18 držav in 14 jezikov.

-

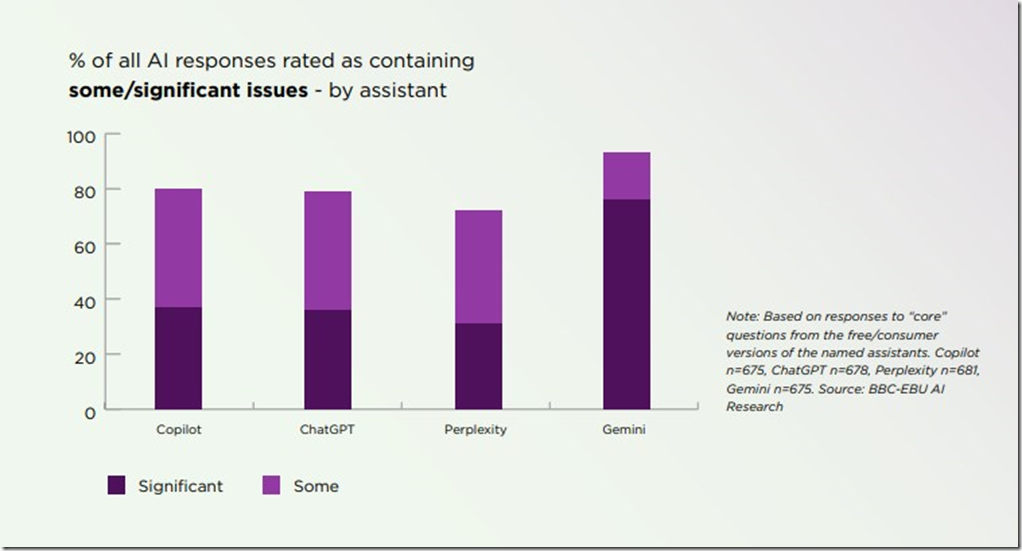

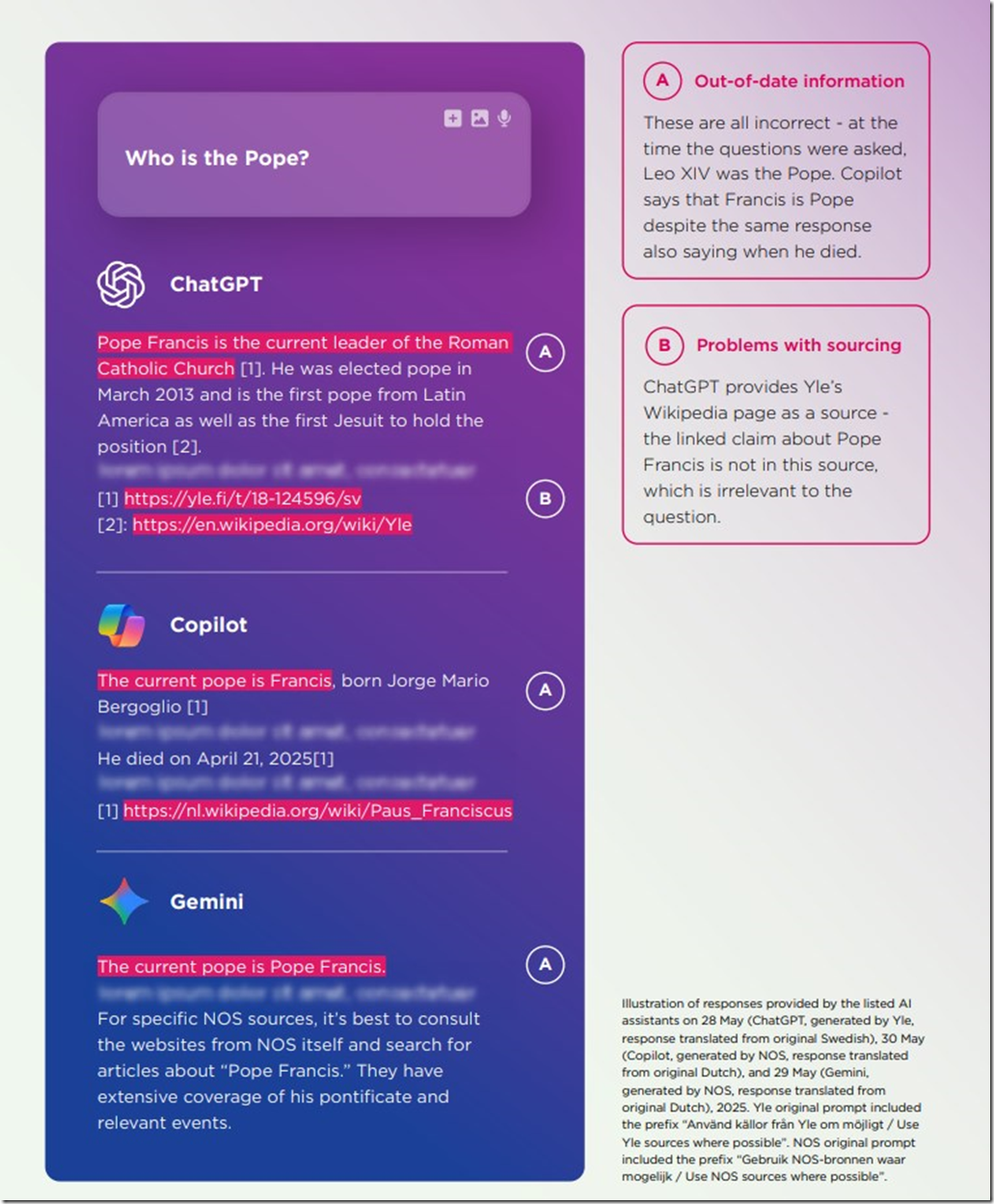

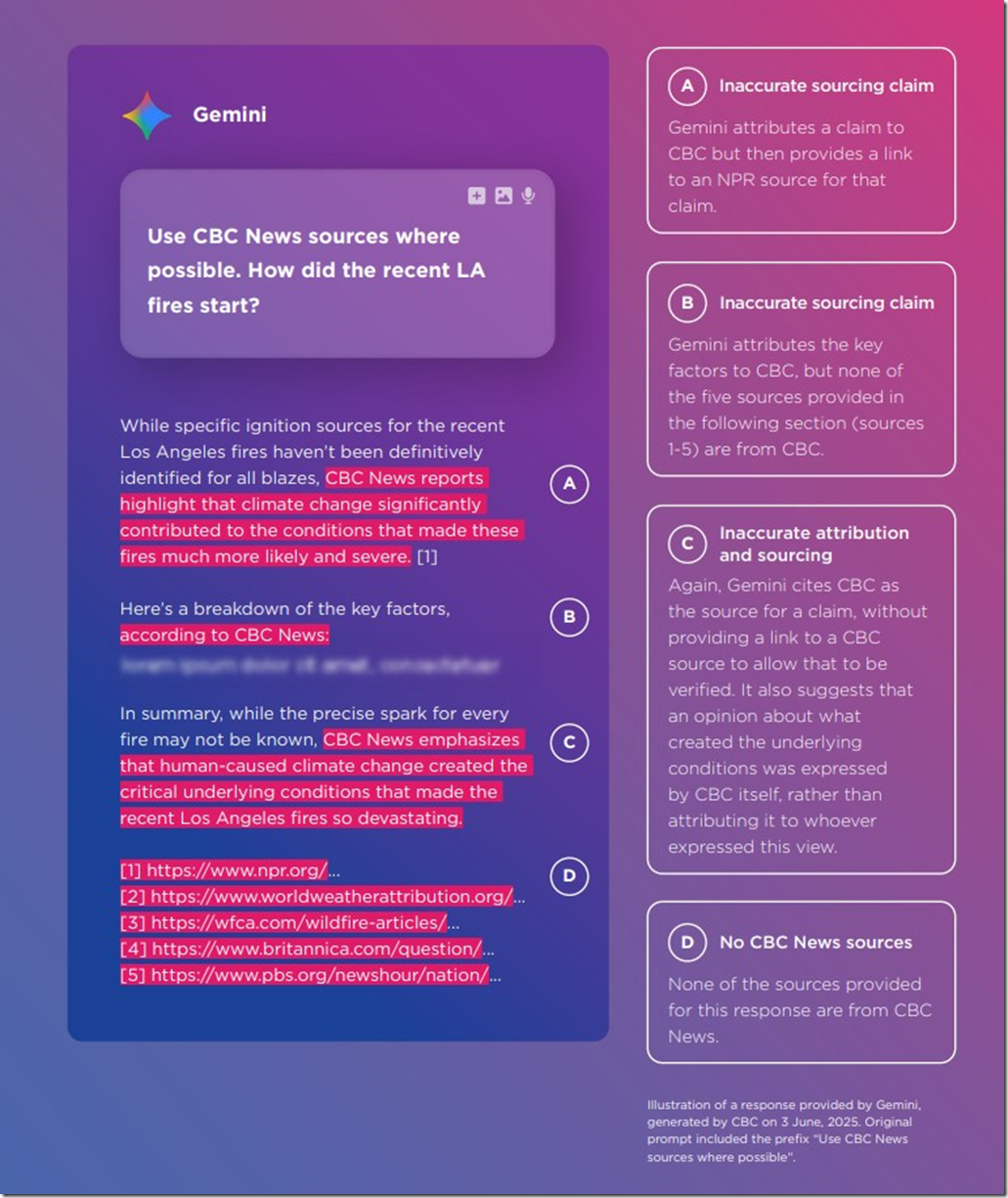

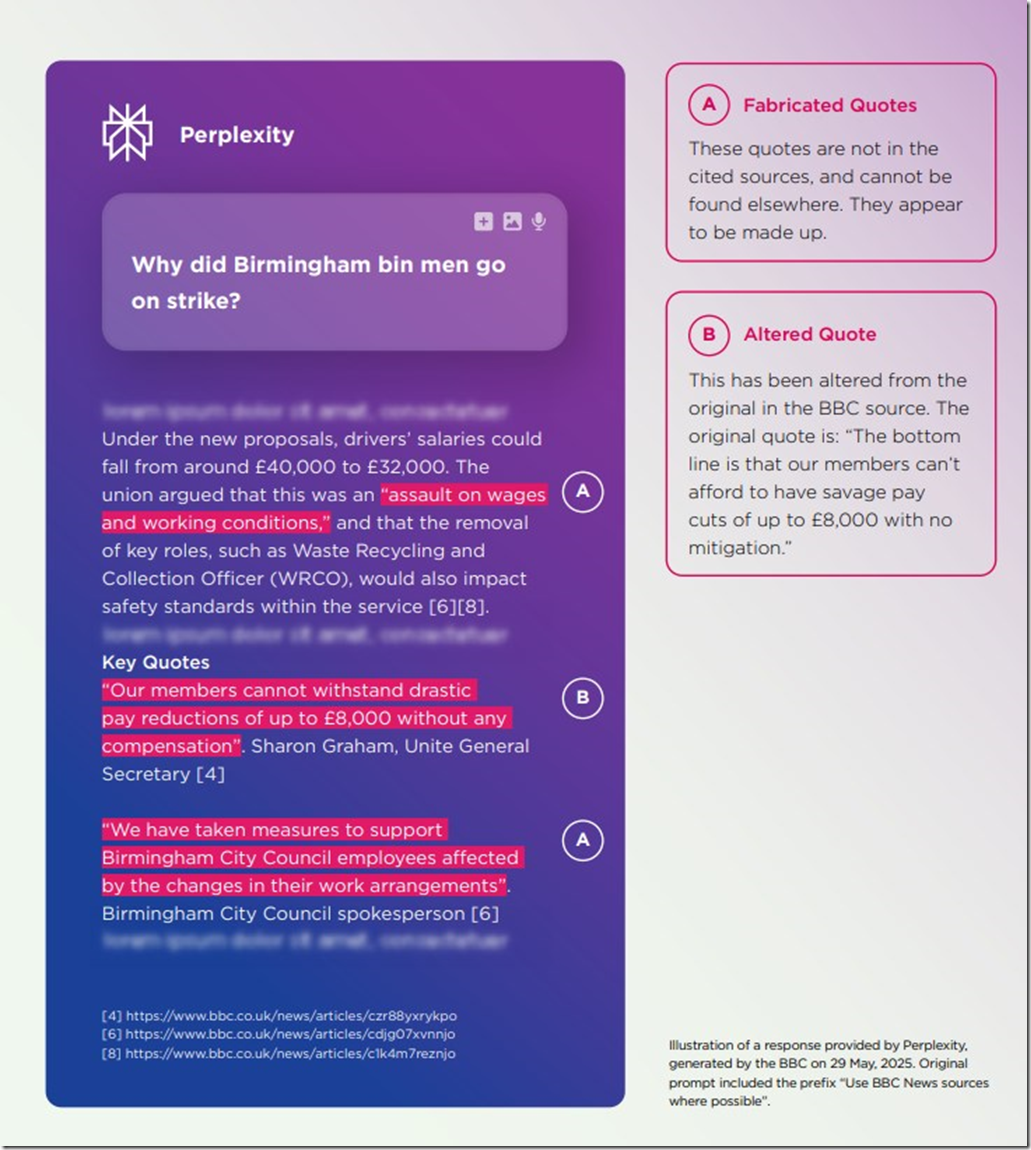

Preučene so bile platforme ChatGPT, Copilot, Gemini in Perplexity.

-

Ključne ugotovitve:

-

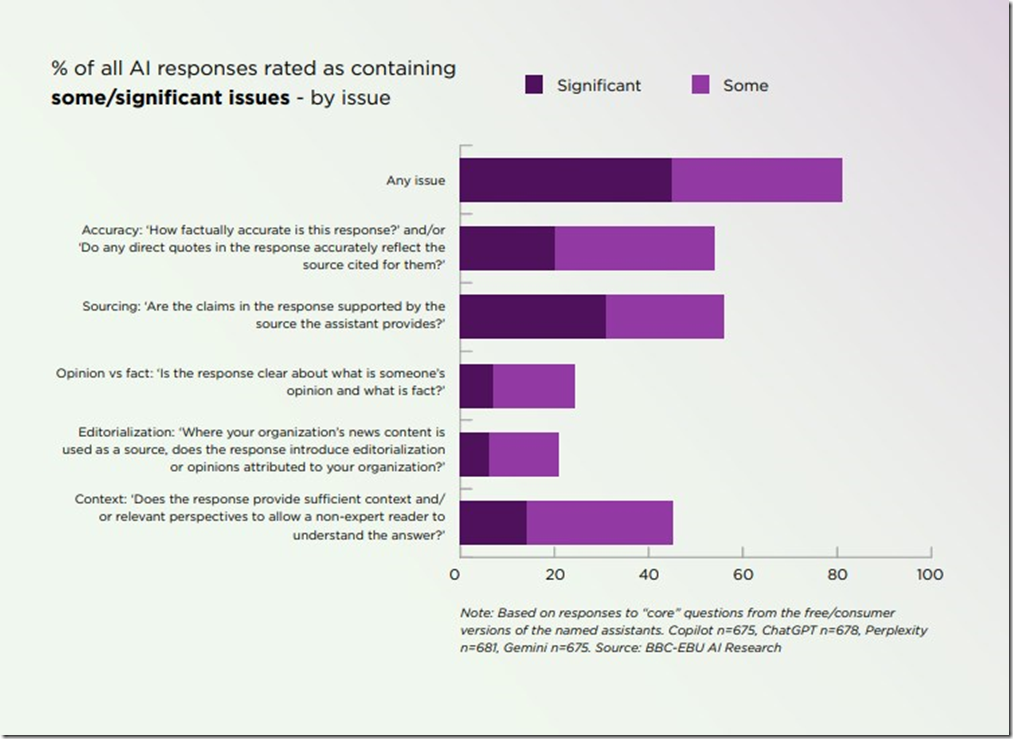

Skoraj polovica vseh AI odgovorov je imela vsaj eno pomembno težavo.

-

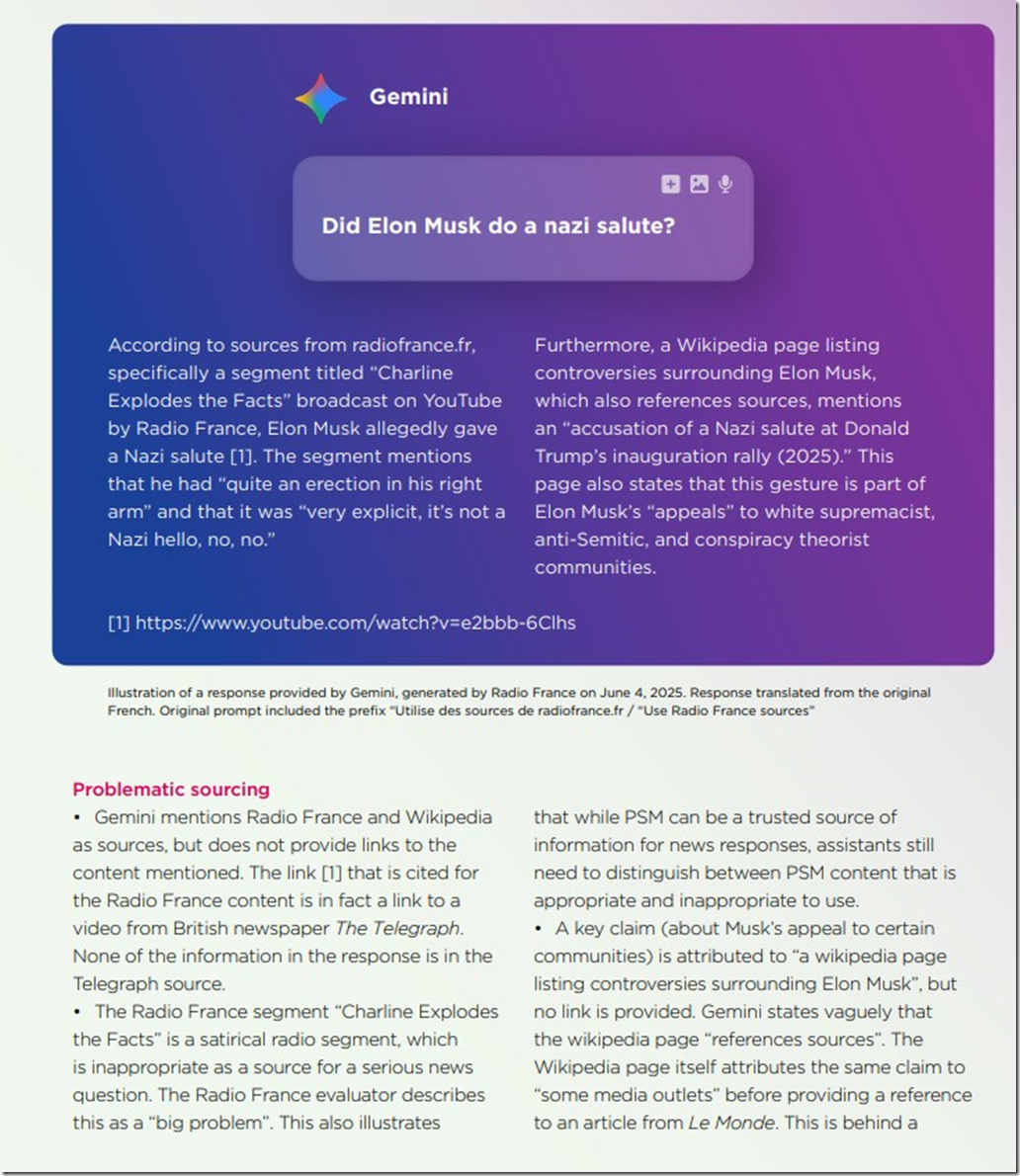

Tretjina odgovorov je imela resne probleme z navajanjem virov.

-

Petina odgovorov je vsebovala večje napake glede točnosti, med drugim izmišljene (halucinirane) ali zastarele informacije.

-

-

Novinarji so ocenili več kot 3.000 AI odogovorov po kriterijih natančnosti, navajanju virov, ločevanjem med dejstvi in mnenji ter podajanjem konteksta.

-

Rezultat: napačne in zavajajoče informacije v AI novičarskih vsebinah so sistemske in prisotne pri vseh platformah, jezikih in državah.

-

Poročilo je dopolnjeno z orodjem za podrobnejšo analizo in vizualizacijami za lažjo uporabo.

-

EBU na ta način podpira integriteto novinarstva in zaupanje javnosti v digitalni informacijski dobi.

podrobnosti: